在AI竞赛的表面,我们看到的是OpenAI的文本生成、Midjourney的图像创造、Suno的音乐合成,它们形态各异。但一个深刻的产业事实正在显现:这些最前沿的AI应用,其底层依赖着同一种基础“语言”,它们都在将人类世界的复杂信息,翻译成机器可理解的数值序列,即向量。

这揭示了一个超越单个模型竞争的核心范式转移:AI能力的竞争,正日益从追求更大的模型参数,转向如何更精准、更高效地将现实世界映射到高质量的向量空间。向量模型,已从一项可选技术,演变为所有AI企业的“战略必修课”。

一、 技术本质:从关键词到语义空间,不止于编码

要理解向量模型的革命性,首先要看它取代了什么。在它之前,机器理解文本主要依赖One-hot编码或关键词匹配。单词“国王”被表示为[0,0,1,0,...],与“君主”[1,0,0,0,...]在数学上毫无关联。这就像用不同的电话号码簿来记录同一个人,机器永远学不会国王与君主相近这个常识。

# 传统One-hot编码示例

king = [0, 0, 1, 0, 0, 0, 0] # "国王"

queen = [1, 0, 0, 0, 0, 0, 0] # "女王"

monarch = [0, 0, 0, 0, 1, 0, 0] # "君主"

# 这些向量的余弦相似度均为0,无法体现语义关系而向量模型(如基于Transformer架构的BERT、GPT)通过自注意力机制和对比学习,实现了分布式语义表示。核心突破在于它将每个词、句、乃至图片,转化为高维空间中的一个稠密向量。这个向量的关键不在于数值本身,而在于向量间的几何关系。例如在语义空间中,Vec(国王) - Vec(男人) + Vec(女人) 的结果会无限接近Vec(女王)。相似概念的向量距离很近,比如狗和宠物,不同概念的向量距离则较远,比如狗和软件。这使得机器第一次能用余弦相似度等数学工具,量化语义相似性,而不仅是字面匹配。

# 向量模型中的语义运算示例

import numpy as np

# 实际应用中,这些向量是768维或更高维

king_vector = np.array([0.2, -0.1, 0.8, ...]) # 国王

man_vector = np.array([0.3, 0.2, 0.1, ...]) # 男人

woman_vector = np.array([-0.1, 0.3, 0.4, ...]) # 女人

queen_vector = np.array([-0.2, 0.4, 0.9, ...]) # 女王

# 计算向量运算

result = king_vector - man_vector + woman_vector

similarity = np.dot(result, queen_vector) / (np.linalg.norm(result) * np.linalg.norm(queen_vector))

print(f"语义相似度: {similarity:.3f}") # 输出接近1的值因此,向量模型的本质是构建机器可理解的语义地图。它将人类模糊、关联性的知识,转化为一张精确、可计算的坐标网络。

衡量这张地图好坏的,不再是单一任务的准确率,而是其在MTEB等海量文本嵌入基准测试中的综合表现。在实际应用中,企业往往需要从多源获取高质量数据来构建专属的语义空间,这正是Dataify这类平台的核心价值——提供从数据抓取、清洗标注到向量化生成的一站式管道,确保企业获得的不是杂乱的原料,而是即插即用的语义基建模块。

二、 工程核心:AI技术落地的效能底座与隐性支撑

如果将大模型(LLM)比作AI的大脑,那么向量模型就是其不可替代的海马体——负责记忆的索引与检索。它在大模型与具体应用之间,扮演着关键的中枢角色。让我们拆解一个典型的现代AI应用技术栈:

1.输入层:多模态的统一入口

无论是用户输入的一段文字、上传的一张产品图,还是一段客服录音,首先被各自的编码器(如CLIP用于图文)转化为同一向量空间中的向量。这打破了数据孤岛,让AI能进行跨模态的理解与搜索。

2.处理层:大模型的记忆外挂与事实校验器

大模型虽有强大的推理能力,但其内部知识可能过时,且易产生“幻觉”(编造信息)。但是依托向量模型与向量数据库,系统可在用户提问时快速检索匹配的最新知识片段,将其作为参考依据与问题一同输入大模型,通过检索增强生成大幅提升回答的准确性与时效性。同时,企业无需耗费高昂成本将全部知识注入大模型进行训练,只需将知识向量化存入数据库,让大模型作为通用处理器,搭配可实时更新的专属记忆体,兼顾效率与成本优势。

# 简化的RAG流程代码示例

def retrieve_augmented_generation(query, vector_db, llm_model):

# 1. 将查询转化为向量

query_vector = vector_model.encode(query)

# 2. 从向量数据库中检索相关文档

relevant_docs = vector_db.similarity_search(query_vector, k=5)

# 3. 构建增强的提示词

context = "\n".join([doc.content for doc in relevant_docs])

prompt = f"基于以下信息回答问题:\n{context}\n\n问题:{query}"

# 4. 调用大模型生成回答

answer = llm_model.generate(prompt)

return answer, relevant_docs # 返回答案和引用来源3.输出层:AI应用创新的核心驱动力

向量技术为上层智能应用提供了核心能力,让系统真正具备深度语义理解能力。在电商场景中,用户搜索"适合夏天通勤的轻薄外套",系统可根据语义相似度,精准匹配"透气"、"防晒"、"商务休闲"等相关商品。在企业场景下,向量技术也能实现智能内容管理,自动对大量文档进行去重、聚类和标签化处理。

三、 产业价值:从消耗算力到沉淀向量化数据资产

当技术普及后,竞争的核心将转向应用效能与数据资产。向量模型在这里为企业构建了新的护城河。

1.成本效率的必然选择

对绝大多数企业而言,从头训练万亿参数的大模型既不经济也不必要。更务实的路径是利用通用大模型或开源模型的基础能力,将企业独有的、结构化的核心数据高质量地向量化,并进行轻量级微调。这能以极低的成本,打造出在特定领域超越通用模型的专属AI。

2.构建反脆弱的知识体系

模型会迭代,API可能涨价,但企业通过向量化沉淀下来的高质量领域数据资产是独有且持久的。这个专属的向量空间,封装了企业的业务流程、客户洞察和专业知识,是竞争对手无法复制的核心竞争力。它让企业的智能系统不依赖于单一外部模型,具备了反脆弱性。

四、Dataify向量模型:化繁为简,赋能AI业务落地

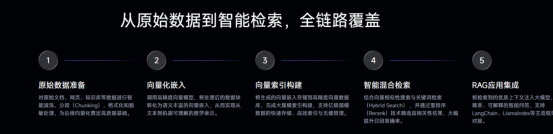

在实际落地中,企业的核心需求是获得端到端的解决方案,而非单一技术组件。Dataify向量模型服务正是为此而生,从数据源头到应用集成提供完整支持,助力企业快速构建专属的语义能力。

1. 开箱即用的流程:覆盖从数据预处理、向量化、索引构建、智能检索到RAG集成的全链路,企业无需自建工程团队即可获得高质量语义能力。

2.解决企业核心痛点:

·实现实时知识更新,让AI回答保持最新

·通过检索增强生成提供有据可依的回答,降低幻觉风险

·将非结构化数据转化为可检索的语义知识库

·支持深度语义搜索,理解用户真实意图

3.企业级服务保障:支持私有部署、多语言适配、轻量集成和高阶技术支持,满足金融、医疗等高合规场景需求。

五、前沿发展与持续挑战

向量模型的广泛应用也使其面临的挑战更加凸显。可解释性问题首当其冲:高维向量如同一个黑箱,其决策逻辑难以被人直观理解,这在金融、医疗等对可追溯性要求极高的领域构成了障碍。其次,偏见与公平性问题不容忽视:训练数据中存在的偏见会在向量空间中被固化甚至放大,导致AI系统产生歧视性输出。此外,实现跨语言、跨文化的精准语义对齐,以及处理动态演变的新兴概念,仍然是待攻克的技术难点。

展望未来,向量模型的研究正朝着更智能、更可靠的方向演进。可解释性AI技术试图打开向量黑箱,让模型的语义理解过程变得透明。持续学习与动态向量技术则致力于使向量空间能够吸收新知识、适应概念漂移,而无需完全重新训练。更为前沿的探索在于,向量可能成为连接数据驱动与知识驱动两种AI范式的桥梁,为构建融合神经网络学习能力与符号逻辑推理能力的下一代AI系统提供关键组件。

六、结语

总而言之,向量模型已深入现代AI系统的核心。它不仅仅是一项将数据转化为数字的技术,更是企业构建自身智能化能力的基石。它使得非结构化的数据变得可计算、可关联、可推理,从而释放出巨大的业务价值。

对于致力于在AI时代构建竞争优势的企业而言,战略性地布局和发展向量化能力,其重要性已不容忽视。这项能力决定了企业能否将自身的数据资源高效转化为可作用于决策、创新与服务的智能资产。在AI技术日益普及的今天,真正的差异化优势,将越来越取决于企业如何利用像向量模型这样的基础技术,在自身独特的业务场景中,构建出高质量、高价值的“数据-智能”闭环。

依托向量模型与向量数据库,系统可在用户提问时快速检索匹配的新的知识片段,将其作为参考依据与问题一同输入大模型,通过RAG大幅提升回答的准确性与时效性。企业无需耗费高昂成本重训大模型,只需更新向量数据库即可保持知识新鲜度。