一、电商数据为什么需要自动化采集

在当今数据驱动的商业生态中,电商平台已不再仅仅是简单的交易场所,更是全球高价值的实时动态数据库。不管是跨国零售巨头还是初创品牌,全需要获取精准的、实时的电商数据,这已成为制定商业决策的核心步骤。

1. 电商数据在商业决策中的价值

高质量的电商数据能够为企业提供多维度的参考。通过自动化采集,企业可以实现:

- 动态定价策略: 实时监控Amazon、eBay等平台的商品价格波动,然后利用工具与算法配合,自动调整产品的价格,以保持市场竞争力。

- 竞品库存监控: 监测竞争对手的库存存量状态,可以来推断其供应链状态及热销单品。

- 评论情绪分析: 提取全部的用户评论,利用NLP(自然语言处理)技术分析消费者痛点,驱动产品迭代。

- 市场需求预测: 通过分析销量排名(BSR)与搜索趋势,提前布局蓝海市场的产品。

| 数据类型 | 典型应用场景 |

| 商品价格 | 价格策略优化、比价工具开发 |

| 商品库存 | 供应链缺口分析、竞品实力评估 |

| 用户评论 | 品牌声誉管理、消费者偏好洞察 |

| 销量排名 | 市场份额占有率统计、爆款挖掘 |

2. 电商网站的技术防护机制

随着各个方面的数据价值提升,大部分电商平台也部署了比较严密的防御措施,用户大规模数据采集面临以下三大技术挑战:

- JavaScript 动态渲染: 现代页面广泛使用 React/Vue 框架,商品详情和评论往往通过异步加载。简单的HTTP请求只能采集到空白模板,必须配合自动化工具解析JS逻辑。

- 短时间IP访问频率: 目标网站会通过后台程序监控单一IP的请求频率。一旦监控到用户的行为特征符合自动化模式,将立即触发 CAPTCHA(验证码)甚至不允许登录注册。

- 地域性内容差异: 电商平台通常采用“低价区域歧视”或“本地化库存”策略。如果你使用固定的网络环境来访问,那么你获取到的价格和运费可能与目标市场真实情况严重脱节。

3. Dataify 在数据采集基础设施中的作用

在这种高强度的环境下,Dataify提供的网页采集API成为了技术破局的关键。Dataify的网页采集API能够模拟全球真实家庭用户的网络环境,将自动化请求转化并包装在合法的住宅网络基础设施中,确保数据采集的稳定性和真实性。

二、Dataify API技术架构解析

与传统的住宅基础网络设施不同,Dataify的网页采集API,提供的是一个全托管的解决方案设计,旨在简化大规模分布式采集的复杂度。

API 核心逻辑:从“通道”到“结果”

- 传统基础网络设施模式: 你获取基础网络设施,自己负责渲染 JS、还需要识别并输入验证码、构造复杂的 Header。

- API 模式: 你发送一个目标电商URL给Dataify,Dataify在后台自动分配住宅节点,并使用高性能无头浏览器(Headless Browser)渲染页面,后面直接返回你所需的 HTML 结果。

核心功能优势

- 自动处理验证码问题: 无需额外集成第三方打码平台,API 自动处理 CAPTCHA。

- 动态 JS 渲染: 支持等待特定元素加载,确保采集到由 React/Vue 渲染的实时价格。

- 内置指纹浏览器: 自动模拟 TLS 指纹与浏览器特征,大幅降低被不允许访问的风险。

三、Python 环境准备:构建轻量化采集工程

由于 Dataify 网页采集 API 承担了页面渲染和数据采集的重担,本地环境不再需要安装复杂的浏览器驱动或处理繁琐的 TLS 指纹库。这使得我们的技术栈更加精简且易于部署。

精简版技术栈选择

为了应对不同的采集场景,我们建议安装以下核心库:

- Requests / Httpx: 仅需用于向 Dataify API 端点发送标准 HTTPS 请求。推荐使用 Httpx,因为它原生支持异步操作,适合高并发采集任务。

- BeautifulSoup4 / lxml: 拿到 API 返回的渲染后 HTML 后,用于提取结构化数据。

- Python-dotenv: 用于安全地管理你的 API_KEY,不用直接将敏感信息硬编码在应用程序中。

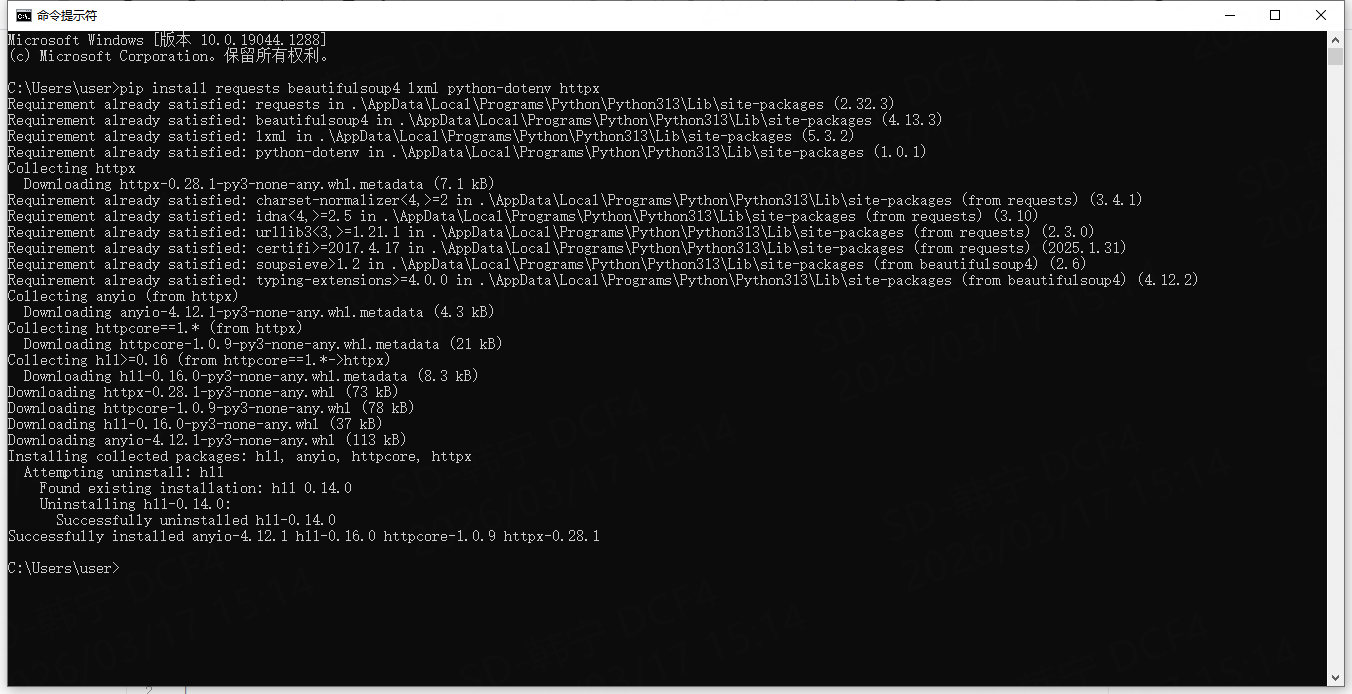

2. 环境安装命令

你只需在终端运行以下命令即可快速完成环境搭建:

# 安装基础通信、解析与配置管理库

pip install requests beautifulsoup4 lxml python-dotenv httpx

3. 规范的项目结构

在 API 模式下,项目结构更侧重于请求构造与数据清洗:

Dataify-api-scraper/

│

├── config.py # 存储Dataify API凭据、目标URL等配置

├── .env # 存储 API_KEY,确保安全

├── api_client.py # 核心模块:封装与 Dataify API 的交互逻辑

├── parser.py # 业务模块:针对不同电商站点的 HTML 解析逻辑

└── app.py # 调度模块:负责大量任务的分发与重试四、Dataify基础网络设施集成

在这一部分,我们将展示如何通过 Python 调用 Dataify 的采集接口。你会发现使用网页采集API代码比使用基础网络设施时更加简洁。

1. 基础连接示例

Dataify 的采集 API 通常通过标准 HTTPS POST 请求调用。以下是一个Python集成示例:

import requests

import json

# Dataify API 配置

API_KEY = "your_api_key"

API_ENDPOINT = "https://api.Dataify.pro/v1/scrape"

def fetch_with_api(target_url):

payload = {

"api_key": API_KEY,

"url": target_url,

"proxy_type": "residential", # 强制使用住宅节点

"render_js": True, # 开启 JS 渲染以应对动态电商页面

"country": "us" # 指定采集地区为美国

}

try:

# 向 Dataify 采集网关发送请求

response = requests.post(API_ENDPOINT, json=payload, timeout=60)

if response.status_code == 200:

result = response.json()

# API 直接返回渲染后的 HTML 内容

return result.get("content")

else:

print(f"采集失败: {response.status_code} - {response.text}")

return None

except Exception as e:

print(f"请求异常: {e}")

return None2. 针对电商场景的进阶参数

为了提升采集效率,Dataify 网页采集 API 支持多种自定义参数:

- Wait_for: 允许指定等待某个 CSS 选择器出现再返回数据(例如等待价格标签 #priceblock_ourprice 加载)。

- Custom_Headers: 虽然 API 自动处理,但你仍可自定义特定的 Cookie 或 Referer。

- Session_ID: 保持会话一致性,适用于需要模拟翻页(Page 1 -> Page 2)的场景。

3. 为什么选择 API 而非单纯基础网络设施?

对于你的新技术网站读者来说,强调这一点非常重要:

- 降低开发成本: 开发者无需再维护复杂的 Playwright/Selenium 环境。

- 按需付费: 通常按成功请求计费,减少了因基础网络设施失效导致的无效成本。

- 高成功率: 针对 Amazon、Shopee 等有严苛 WAF 的平台,API 的穿透能力远强于普通基础网络设施。

五、解决电商平台的复杂数据采集程序

当采集规模达到万级甚至百万级时,单纯拥有高质量的基础网络设施是不够的。你需要构建一套完整的“数据采集体系”,让你的大规模数据采集自动化程序在目标服务器眼中与真实的购物者没有差别。

1. 动态Header随机化与指纹生成

现在主流的电商平台会检查请求头(Headers)的完整性。一个合格的请求必须包含User-Agent、Accept-Language和Referer。

技术实现: 利用 fake-useragent 库结合 Dataify 的位置信息,生成匹配的请求头。例如,如果你调用了 Dataify 的美国节点,你的 Accept-Language 应该包含 en-US。

from fake_useragent import UserAgent

ua = UserAgent()

def get_optimized_headers():

return {

"User-Agent": ua.random,

"Accept-Language": "en-US,en;q=0.9",

"Referer": "https://www.google.com/",

"Accept": "text/html,application/xhtml+xml,xml;q=0.9,image/webp,*/*;q=0.8"

}2. 指数退避(Exponential Backoff)与自动重试

在大规模采集任务中,网络波动或目标站点的瞬时限流不可预测。

策略方案: 不要立即重试。建议采用指数退避算法,即重试等待时间随失败次数呈指数增长(如 2s, 4s, 8s...)。配合 Dataify 配置不同网络环境的特性,重试时通常会由新的节点发出,大幅度地提高了成功率。

3. 利用 ThreadPoolExecutor 实现并发采集

单线程采集无法满足商业需求。Python 的 concurrent.futures 模块可以轻松实现多线程加速。

from concurrent.futures import ThreadPoolExecutor

import requests

url_list = ["https://example.com/p/1", "https://example.com/p/2", ...] # 目标列表

header = {

}

def fetch_product_data(url):

try:

# 发起 HTTP 请求

response = requests.get(url, headers=header, timeout=10)

# 检查状态码

if response.status_code == 200:

try:

data = response.json()

return {"url": url, "status": "success", "data_preview": str(data)[:50]}

except:

# 如果不是 JSON,返回文本前 50 字

return {"url": url, "status": "success", "data_preview": response.text[:50]}

else:

return {"url": url, "status": "error", "msg": f"HTTP {response.status_code}"}

except requests.exceptions.Timeout:

return {"url": url, "status": "error", "msg": "请求超时"}

except requests.exceptions.RequestException as e:

return {"url": url, "status": "error", "msg": str(e)}

except Exception as e:

return {"url": url, "status": "error", "msg": f"未知错误: {str(e)}"}

def start_scraping():

with ThreadPoolExecutor(max_workers=10) as executor:

executor.map(fetch_product_data, url_list)六、数据解析与结构化存储

采集到原始HTML后,如何精准提取并稳健地存储数据,决定了后期数据分析的质量。

1. 使用 CSS 选择器进行精准解析

电商网站结构复杂,建议优先使用CSS选择器(Selector),其可读性和解析速度优于正则表达式。

def parse_html(html_content):

soup = BeautifulSoup(html_content, "lxml")

item = {

"title": soup.select_one("#productTitle").get_text(strip=True) if soup.select_one("#productTitle") else None,

"price": soup.select_one(".a-price-whole").get_text(strip=True) if soup.select_one(".a-price-whole") else None,

"rating": soup.select_one("#acrCustomerReviewText").get_text(strip=True) if soup.select_one("#acrCustomerReviewText") else "0",

}

return item2. 大规模存储方案:MongoDB vs PostgreSQL

对于电商数据,我们推荐以下存储架构:

- MongoDB(优先选用): 由于不同品类的商品字段(Schema)差异很大(例如手机有内存参数,服装有尺码),NoSQL 数据库的灵活性非常适合存储这种非结构化或半结构化的 JSON 数据。

- PostgreSQL:

如果你的业务需要进行复杂的关联查询(如跨平台比价分析),PostgreSQL 强大的 JSONB 支持和 ACID 特性能提供更强的可靠性。

| 维度 | Excel/CSV | MongoDB | PostgreSQL |

| 承载量 | 万级以下(卡顿) | 千万级+ | 千万级+ |

| 查询性能 | 低 | 高(索引) | 高(关系型) |

| 扩展性 | 无 | 强(水平分片) | 一般 |

3. 数据清洗建议

在入库前,务必进行去重(使用 URL 的 MD5 值作为索引)和类型转变(将价格字符串转变为 Float 类型),这能为后续的数据挖掘节省大量处理时间。

七、性能优化与合规采集建议

在一个成熟的生产环境中,除了“能抓到数据”,我们还需要关注“如何更高效、更安全地采集”。

引入 Redis 缓存机制

在大规模采集任务中,重复请求同一页面是很大的资源浪费(不管是流量成本还是时间成本)。

优化方案: 建议使用 Redis 记录已采集的 URL 及其指纹(Hash)。在发送请求前先检索缓存,如果数据在有效期内(如 24 小时),直接从缓存读取。这不仅能保护 Dataify 节点的流量额度,还能显著提升系统吞吐量。

请求频率的设定

即使 Dataify 提供了高权重的基础网络设施,但是持续不断的固定频率请求(如每秒精确请求 10 次)依然容易被目标站点的流量监控系统(Sentinel 等)识别。

技术技巧: 在代码中引入 random.uniform(min, max)。通过在请求间隙加入随机的微小延迟,从而解决了复杂的行为分析算法。

商业道德合规

作为专业的技术团队,数据采集必须在合规的框架下运行:

- 遵循Robots.txt: 尊重目标网站的数据采集协议,减少对非公开数据进行越权采集。

- 设定并发力度: 采集的原则是“获取所需数据”,而非“压垮目标服务器”。合理配置并发数,确保不影响目标站点的正常用户访问。

- 隐私保护: 在电商数据采集过程中,应专注于商品、价格和评论等公开信息,严禁采集任何涉及用户个人身份(PII)的敏感数据。

八、总结与未来趋势展望

通过集成Dataify自动化API,我们成功构建了一个能够减少数据采集风险且具备高并发采集能力的电商数据采集系统。从环境搭建到采集策略,每一个环节的优化全部在为数据的稳定性保驾护航。Dataify结合Python异步生态与数据采集的算法,实现了从“数据获取”到“数据资产化”的转变。

随着Web 3.0和AI技术的深度融合,未来的电商数据采集将向 “语义化采集” 演进。AI模型将不再依赖硬编码的CSS选择器,而是通过大模型(LLM)自动识别网页结构。在这种趋势下,像Dataify这样稳健、底层的网络接入基础设施,将成为企业构建私有 AI 数据池的基石。